なぜ“AI禁止”は裏目に出るのか? シャドーAIを防ぎ、安全な利活用を叶える公式導入の考え方

「情報漏えいリスクがあるから、生成AIは原則禁止」。セキュリティを第一に考える情シスとして、この判断は一つの正解です。しかしその禁止が、社員が個人の判断で未許可のツールを使う“シャドーAI”の引き金となり、かえってリスクは高まるかもしれません。

法人向けAIを公式に導入し、組織の管理下に置ける環境を整えることこそが、実効性の高いセキュリティ対策の一歩となるのです。

- AIの全面禁止が「隠れたリスク」を作ってしまう理由

- 公式導入のメリットは、再学習を防ぐ“オプトアウト”

- 大切なのは、ツール選びよりも「どのデータを入れていいか」

- リスクを可視化し、見守ることが情シスの新しい役割

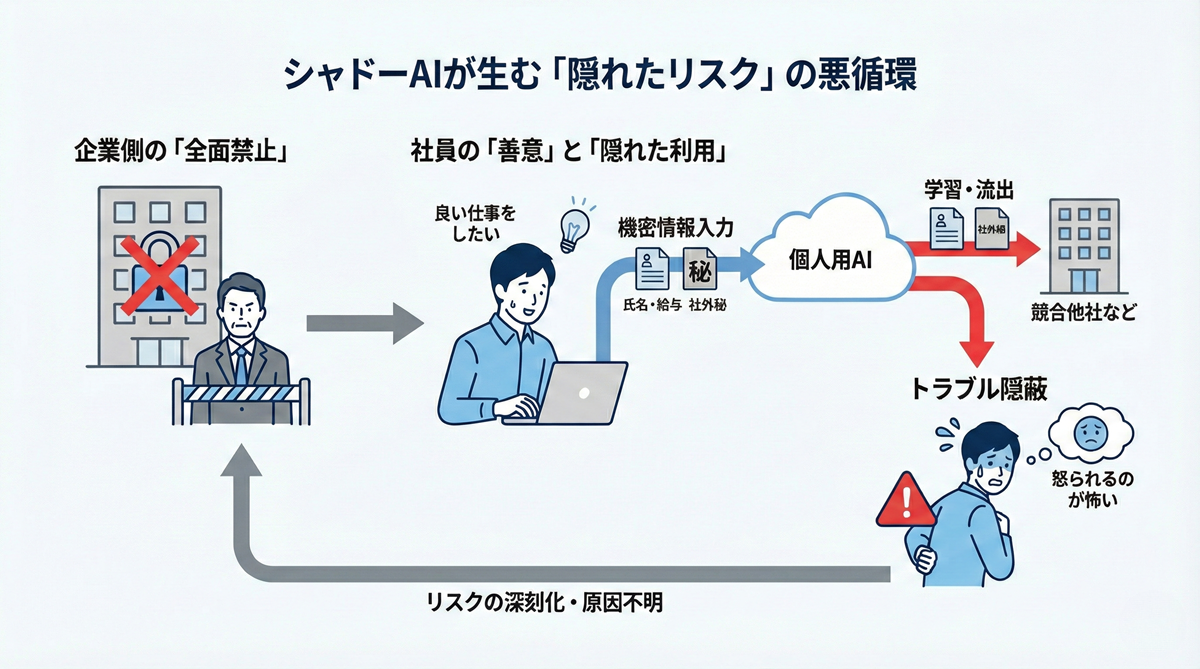

AIの全面禁止が「隠れたリスク」を作ってしまう理由

こっそりAIを使う社員たちに悪意はなく、「もっと良い仕事がしたい」「早く課題を解決したい」という前向きな気持ちからAIを使います。しかし、会社が用意したルールや環境がないと、つい個人の判断で一線を超えてしまいます。

というのも、AIの個人利用では「データがどう扱われるか」や「いつまで保存されるか」といったルールが、使う本人にまで正しく伝わっていないケースがあるからです。

その結果、大切な情報がきちんと管理されないまま外部サービスへ送られてしまう心配が出てきます。どこにデータがあり、誰がアクセスできるのかを情シスが確認できない。このコントロールできない状況こそが、見えない大きなリスクなのです。

さらに、「原則禁止」というルール下では、意図せぬミスが起きた際に心理的な報告ハードルが上がり、結果としてリスクが潜在化しやすくなるという構造的な課題があります。早期の相談や報告がなされない環境は、いざ問題が発生した際の原因特定を遅らせ、状況を悪化させてしまう懸念があるのです。

公式導入のメリットは、再学習を防ぐ“オプトアウト”

こうしたリスクを解消するには、禁止ではなく、「ここまではOKという、安心できる環境」を用意することが効果的。そのための大きな助けとなるのが、法人向けプランにある「オプトアウト設定」です。

オプトアウトは個人向けプランでも設定可能ですが、法人向けプランの多くは、最初から設定がオンになっています。大きな違いは、情シスが管理画面からその設定を「全員分まとめて固定」できる点。個人任せにしないため、全社的にデータの二次利用を抑え、会社の手が届く範囲で運用できるようになります。

そのほかにも違いがあるので、以下の表でまとめました。

| 項目 | 個人向けプラン | 法人向けプラン |

|---|---|---|

| データ学習(再学習) | 標準で利用される(自身でオプトアウト設定をオンにする必要がある) | 標準で利用されない(最初からオプトアウト設定がオンになっている) |

| データの安全性 | 標準的な暗号化 | SOC 2 / ISO等の国際基準 |

| ユーザー管理 | 不可 | SSO / 管理コンソール |

| ログ監視 | 不可 | 監査ログの取得可能(適正利用の確認のため) |

オプトアウト設定をしても外部クラウドへデータを送信すること自体に変わりはありませんが、「意図しない二次利用」を防ぎ、管理可能な状態を構築できることは大きな前進です。

大切なのは、ツール選びよりも「どのデータを入れていいか」

ツール側で対策をしたら、次は社内ルールを定めましょう。AI活用のポイントは、ツールそのものよりも、「会社としてどのデータを外に出してよいか」を整理することにあります。

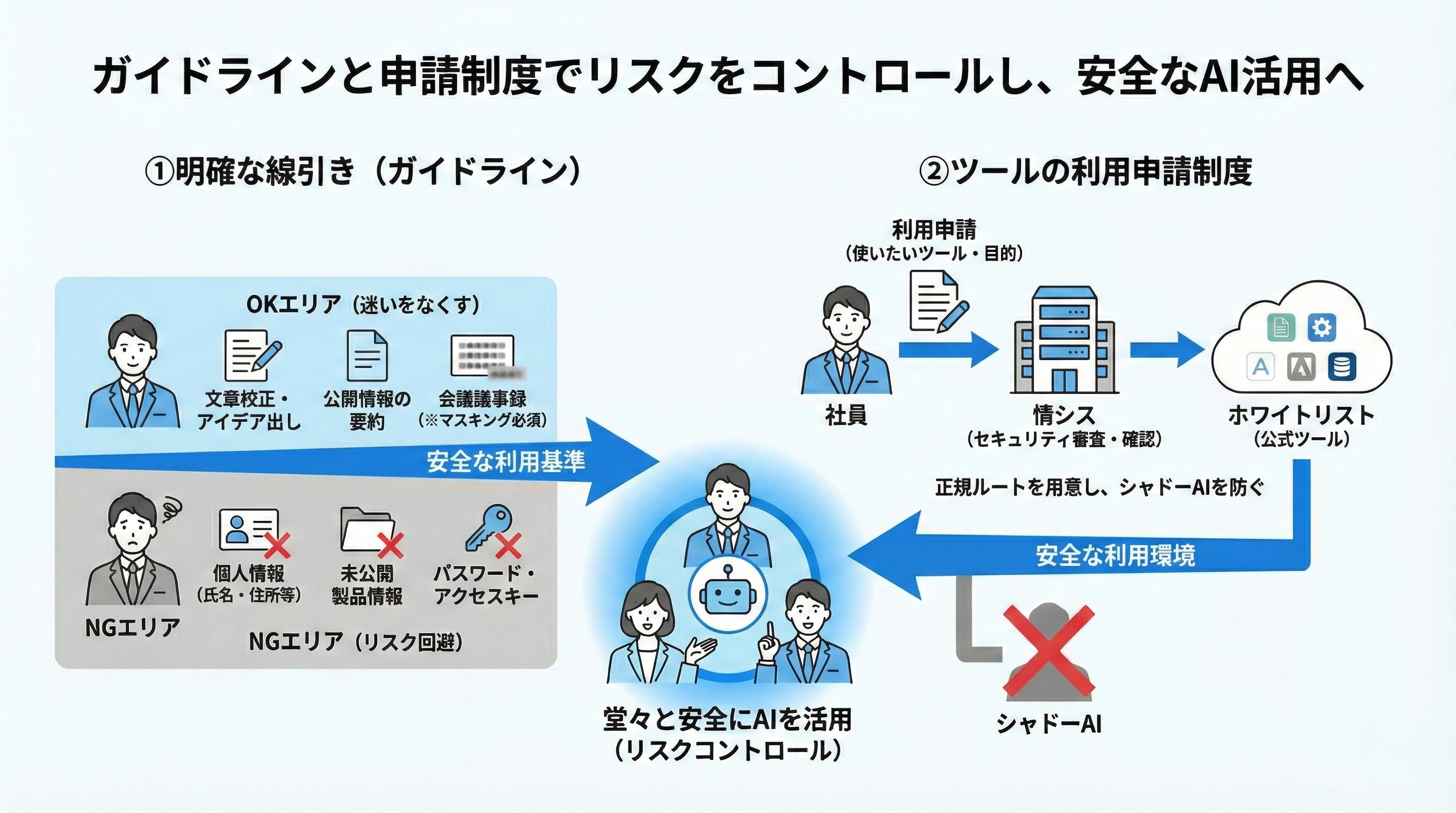

現場が迷わないための明確な線引き(ガイドライン)

現場の社員が危険な使い方をしてしまう原因の多くは、「何がダメで、何が良いのか」という境界線が曖昧なことにあります。「機密情報の入力禁止」と伝えるだけでは不十分です。人によって解釈がブレないよう、具体例を挙げることが効果的なリスク対策になります。以下に具体例をまとめました。

【OKな例】

- 文章の校正

- アイデア出し

- すでに世に出ている情報の要約(プレスリリースなど)

【条件付きOKな例】

- 会議の議事録作成

※条件: 固有名詞はすべて「A社」「B様」などに置き換える(マスキングする)

【NGな例】

- 個人情報(氏名、住所、電話番号など)

- まだ世に出ていない製品情報や仕様書

- パスワードやシステムへのアクセスキー

ポイントは、一律にダメと突き放すだけでなく代替案を示すこと。そうすることで現場の利便性を損なうことなく、リスクをコントロールできます。

シャドーAIを防ぐツールの利用申請制度

便利なAIツールは日々増え続けています。ここで「会社が指定したAI以外は一切禁止」とすると、現場では再びシャドーAIが発生する可能性があります。

そこで、使いたいツールがあれば申請できるルートを正規に用意しましょう。社員に利用したいツール名・利用目的を申請してもらい、情シス側でセキュリティ規約(データが学習されないか等)を確認した上で、ホワイトリストに追加していく。

単に禁止するのではなく、審査を通せば使えるという仕組みを用意することで、透明性の高い利用環境を作れます。

リスクを可視化し、見守ることが情シスの新しい役割

生成AIの活用において、セキュリティと利便性はトレードオフの関係ではありません。法人向けプランという「守り」と、ガイドラインという「道しるべ」をセットで提供することで、組織全体のリスクを低減できます。

これからの情シス部門に求められるのは、ただ制限をかけることではなく、「ここまでは大丈夫だよ」という確かな土台を築くこと。それが、シャドーAIから会社を守り、みんなでAIを活用していく大きな力になるでしょう。

AIツールの新着記事

AIツールのランキング

探すのに時間がかかる

相場がわからない

複数を比較しづらい

プロが代わりに探して紹介します!